Чтобы принять продуманное решение, требуется много времени. Но порой мозг ленится и использует привычные шаблоны, из-за этого вы можете лишиться сбережений или пойти на поводу у маркетологов. Это результат когнитивных искажений — определенных ошибок мышления, к которым склонен каждый. «Холод» рассказывает, откуда берутся когнитивные искажения и какими они бывают.

Чтобы не пропускать главные материалы «Холода», подпишитесь на наш инстаграм и телеграм.

Представьте Алису: она уже три года работает маркетологом и добилась немалых успехов. Теперь начальник предлагает ей возглавить команду. После нескольких дней раздумий она отказывается: ей страшно переходить на новую должность, поэтому девушка решила оставить все как есть.

Исследования показывают, что такое поведение встречается нередко. Люди не решаются на перемены — будь это выбор плана медицинского страхования или места для отпуска, — даже если сохранение нынешней ситуации влечет большие издержки. Такое явление называют отклонением в сторону статус-кво (status quo bias) — и это одно из многих когнитивных искажений.

Почему возникают когнитивные искажения?

Главная причина в том, как работает наше мышление.

Люди обрабатывают и интерпретируют информацию, а после принимают решения или выносят суждения. Но иногда наше мышление хитрит и использует определенные шаблоны, чтобы сильно не утруждаться при работе с информацией. Как следствие, мы превратно интерпретируем факты и принимаем не очень рациональные решения. Так описывают этот процесс израильские психологи Даниэль Канеман и Амос Тверски — авторы термина «когнитивные искажения».

В конце 1960-х — начале 1970-х годов два этих психолога взялись за исследование человеческого поведения — точнее, того, как человек принимает решения. В то время предполагалось, что люди по большей части принимают рациональные решения и действуют в своих интересах, ради собственной выгоды. Это оказалось не так, поскольку тогдашние модели принятия решений учитывали лишь теорию вероятностей и экономическую пользу.

Долгое время в экономике господствовала идея, что человек — эдакая машина по максимизации собственной пользы. Он всегда поступает рационально, стремится приумножить выгоду и сократить расходы. Но оказалось, что это не соответствует действительности.

Для начала следует перенестись в Шотландию эпохи Просвещения. В 1776 году профессор этики Адам Смит опубликовал свой opus magnum — «Исследование о богатстве народов». Ключевая идея работы — люди работают ради собственной выгоды, а рынок выступает универсальным регулятором, который позволяет удовлетворить нужду наиболее эффективно.

«Каждый отдельный человек постоянно старается найти наиболее выгодное приложение капитала, которым он может распоряжаться, — пишет Смит. — Он имеет в виду свою собственную выгоду, а отнюдь не выгоду общества. Но когда он принимает во внимание свою собственную выгоду, это… приводит его к предпочтению того занятия, которое наиболее выгодно обществу».

Однако Смит также отмечал, что люди не всегда поступают так, чтобы верно распорядиться капиталом. «Каждый более или менее переоценивает шансы удачи, а шансы неудачи большинством людей недооцениваются, и вряд ли найдется такой человек, мало-мальски здоровый и бодро настроенный, который преувеличивал бы их».

Почти через 40 лет англичанин Давид Рикардо стал последователем Смита — и одновременно дотошным критиком. Он придумал упрощенные модели, с помощью которых объяснял мировую торговлю (с опорой на идеи Смита), описал трудовую теорию стоимости — предметы пропорционально обмениваются на труд, затраченный на их производство. А еще в своих рассуждениях исходил из предпосылки, что человек есть существо, которое заботится только о своей выгоде. Так появилась классическая экономическая теория.

Но человек слаб, волен поддаваться соблазнам и искушениям, поэтому не всегда способен действовать с оглядкой на разум, чтобы стяжать собственную выгоду. В 1970-х экономистам взялись это доказывать психологи — главные специалисты по поведению человека. После долгих исследований и дискуссий они показали, что на человеческое поведение влияют прошлый опыт, эмоции, психическое состояние и окружение. Это влияние можно изучать, чем и занялась новая область знания — поведенческая экономика.

«Канеман и Тверски тесно сотрудничали с рядом известных экономистов-теоретиков и обнаружили, что они описывают свои модели с базовым допущением: принимающий решение агент рационален и обладает всей полнотой информации, — говорит кандидат психологических наук, научный сотрудник лаборатории когнитивных исследований ИОН РАНХиГС Никита Логинов. — Но с точки зрения психологии это совсем не так». Ученые провели несколько исследований, в которых показали особенности человеческого мышления.

Иногда мы склонны думать, что некие события происходят чаще, чем есть на самом деле. Простой пример — лотереи. Если кому-то посчастливилось вытащить нужный билет и об этом рассказали СМИ, то некоторые люди невольно пересматривают свои шансы на выигрыш. А итогом становятся непомерные траты, хотя шансы выиграть в лотерею не изменились и по-прежнему очень низки. Похожая ситуация происходит с упоминаниями нападений акул и авиакатастрофами — Канеман и Тверски назвали такое явление эвристикой доступности.

По определению Канемана и Тверски, эвристика — это ментальный ярлык или «эмпирическое правило», которое помогает нам выносить суждения, когда информация или время ограничены. А эвристика доступности — это тип ярлыка, который мы используем для оценки вероятности события. В одних случаях это помогает быстро принять решение, а в других — заводит в ловушку.

В 1979 году Канеман и Тверски опубликовали работу «Теория перспектив: анализ решений в условиях риска». В ней психологи критикуют гипотезу ожидаемой полезности — эта некогда популярная экономическая идея исходит из допущения, что люди — рациональные агенты. Результаты исследований психологов показали, что люди недооценивают риски, а значит, не всегда поступают рационально. В 2002 году Даниэль Канеман получил Нобелевскую премию по экономике «за интеграцию идей психологических исследований в экономическую науку, особенно в отношении человеческих суждений и принятия решений в условиях неопределенности» (вероятно, ее получил бы и Амос Тверски, но он скончался в 1996 году, а посмертно Нобелевские премии не присуждаются).

Исследования Канемана и Тверски растянулись на десятилетия, и, чтобы обобщить все наблюдения, в 2011 году Канеман выпустил книгу «Думай медленно… Решай быстро» (в оригинале — «Thinking, Fast and Slow»), где он пересказывает исследования простым языком. В ней он описал мышление человека как работу двух систем: Системы 1 и Системы 2. Выглядят они так:

Система 1 срабатывает автоматически и очень быстро, не требуя или почти не требуя усилий и не давая ощущения намерения: мы даже не задумываемся, что это нужно сделать, а сразу делаем.

Она решает такие задачи:

Система 2 выделяет внимание, необходимое для сознательных умственных усилий, в том числе для сложных вычислений. Действия Системы 2 часто связаны с субъективным ощущением деятельности, выбора и концентрации.

Она решает такие задачи:

Эти две системы ответственны за принятие решений. Канеман считает, что одни действия мы совершаем на автомате, другие — предварительно обдумав. Но иногда автоматическое мышление принимает решения слишком быстро — и тогда возникают систематические ошибки, или же когнитивные искажения. «Те простые правила, по которым мы принимаем решения быстро и автоматически, иногда оказываются неэффективными и приводят к искажениям», — добавляет Никита Логинов. Чтобы с ними бороться, нужно вовремя притормаживать принятие решения. По сути, Канеман говорит, что нужно включать Систему 2.

«Мне кажется, что Канеман придумал Систему 1 и Систему 2, чтобы объяснить непсихологам, как работает мышление, — говорит доктор психологических наук, заведующий лабораторией когнитивных исследований Института общественных наук РАНХиГС Владимир Спиридонов. — Это безумное упрощение, зато экономисты, юристы и управленцы на этом примере смогут понять кое-что про собственное мышление».

Да, но со временем другие ученые внесли в эту теорию некоторые уточнения.

Немецкий психолог Герд Гигеренцер считает, что когнитивные искажения — результат нормальной работы мышления. «Наше мышление в одних ситуациях сбоит, а в других работает эффективно. Гигеренцер подчеркивает этот тезис и говорит, что ругать когнитивные искажения — занятие бесперспективное. Потому что они сами по себе — норма», — говорит Владимир Спиридонов. Как писал сам Гигеренцер, «предвзятый ум может более эффективно и надежно справляться с неопределенностью, чем беспристрастный».

Какие бывают когнитивные искажения?

Их более 150 — столько когнитивных искажений содержится в списке «Википедии». Одни касаются недавних воспоминаний, другие — информации, которая противоречит нашим убеждениям, а третьи — нашей способности замечать причудливое и необычное. Но полностью систематизировать когнитивные искажения ученым пока не под силу: их механизмы мало изучены.

«В Википедии к когнитивным искажениям относится все подряд, что не совсем корректно, — замечает Никита Логинов. — Канеман описывал когнитивные искажения как ошибки мышления. То, что существуют ошибки в памяти, во внимании, восприятии, спору нет, но они к когнитивным искажениям не относятся. Для них есть другие названия вроде зрительных иллюзий, ложных воспоминаний и так далее».

Владимир Спиридонов считает, что «рано или поздно кто-нибудь обобщит когнитивные искажения — и вместо отдельных кусочков мозаики будет понятен узор». Но пока ученые разбираются в этом хитросплетении, остановимся на нескольких распространенных ловушках мышления и рассмотрим их подробно.

Ловушка невозвратных затрат

В 1960-х годах Франция и Великобритания взялись за совместный проект — разработку сверхзвукового авиалайнера вместимостью приблизительно 100 человек. Амбициозная задача отняла немало ресурсов — и со временем расходы росли все больше. Но отказываться от проекта партнеры не спешили, поскольку уже было вложено очень много денег и труда. Первый коммерческий рейс «Конкорда» — так назывался лайнер — состоялся в 1976 году, однако уже в 1979 году производство свернули, а в 2003-м остановили полеты существующих «Конкордов». Проект был экономически неэффективен: затраты оказались почти в шесть раз больше запланированных.

Иногда люди — в том числе политики и бизнесмены — продолжают вкладывать ресурсы в заведомо бесперспективное дело, потому что им жалко потраченных денег или усилий. Это может быть строительство инфраструктурного проекта в малонаселенном районе, инвестиции в подозрительную фирму или даже в опостылевшие отношения. Такое явление называют ловушкой невозвратных затрат (она же эффект невозвратных издержек — sunk cost fallacy).

Это когнитивное искажение работает не только у людей, но и у животных. В 2018 году группа исследователей из Университета Миннесоты в США обнаружила, что механизм этот похож у крыс, мышей и людей. Эксперименты проходили в лаборатории. Грызуны должны были найти ароматизированные гранулы в лабиринте, люди — видеоролики в интернете. Чем больше времени уходило на поиск «награды», тем сильнее проявлялся эффект невозвратных затрат. Ученые считают, что такие исследования — использование экономических идей в натуралистических экспериментах — могут пролить свет на нейробиологическую основу принятия решений.

Систематическая ошибка выжившего

Судьбы Марка Цукерберга и Билла Гейтса схожи. Оба родились в обеспеченных семьях, поступили в Гарвард, а потом бросили университет, чтобы заняться бизнесом. Оба основали компании, чья стоимость сегодня превышает ВВП большинства стран мира. И оба служат примером для студентов, которые хотят оставить учебу, чтобы заняться собственным делом, хотя людей, которые бросили университет и не преуспели, намного больше.

Так выглядит систематическая ошибка выжившего (survivorship bias) — когнитивное искажение, когда мы фокусируемся на успешных кейсах («выжившие»), в своих суждениях пренебрегая неудачами («погибшие»).

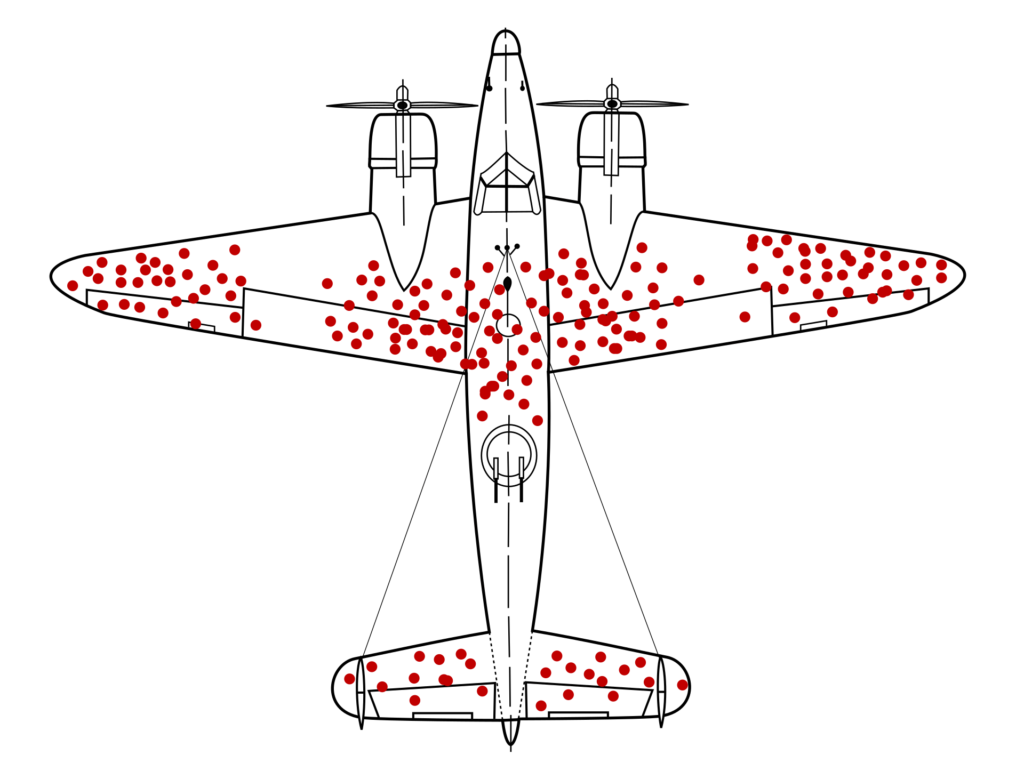

Хорошим примером работы ошибки выжившего служит история математика Абрахама Вальда, который нашел способ защитить американские бомбардировщики, не поддавшись когнитивному искажению.

Во время Второй мировой войны самолеты вылетали на задание и зачастую не возвращались на базу. Группа статистических исследований Колумбийского университета, в которой работал Вальд, должна была оценить уязвимости самолетов, а потом найти способ улучшить их бронирование. Результаты исследований вскоре оказались на столе военных, которым было предложено укреплять крылья и фюзеляж.

В своем анализе Вальд пошел от обратного: он предложил укреплять в самолетах те места, которые у вернувшихся после вылета оставались невредимы. Математик заметил, что самолеты способны долететь до базы с пробоинами в крыльях, в центре корпуса и хвосте — именно эти места были чаще всего пробиты. А значит, решил он, надо укреплять те части, которые оказывались неповрежденными — кабину и двигатели, — поскольку, вероятно, именно попадания по ним становились для самолета роковыми. Военные так и поступили.

Иллюзия глубины понимания

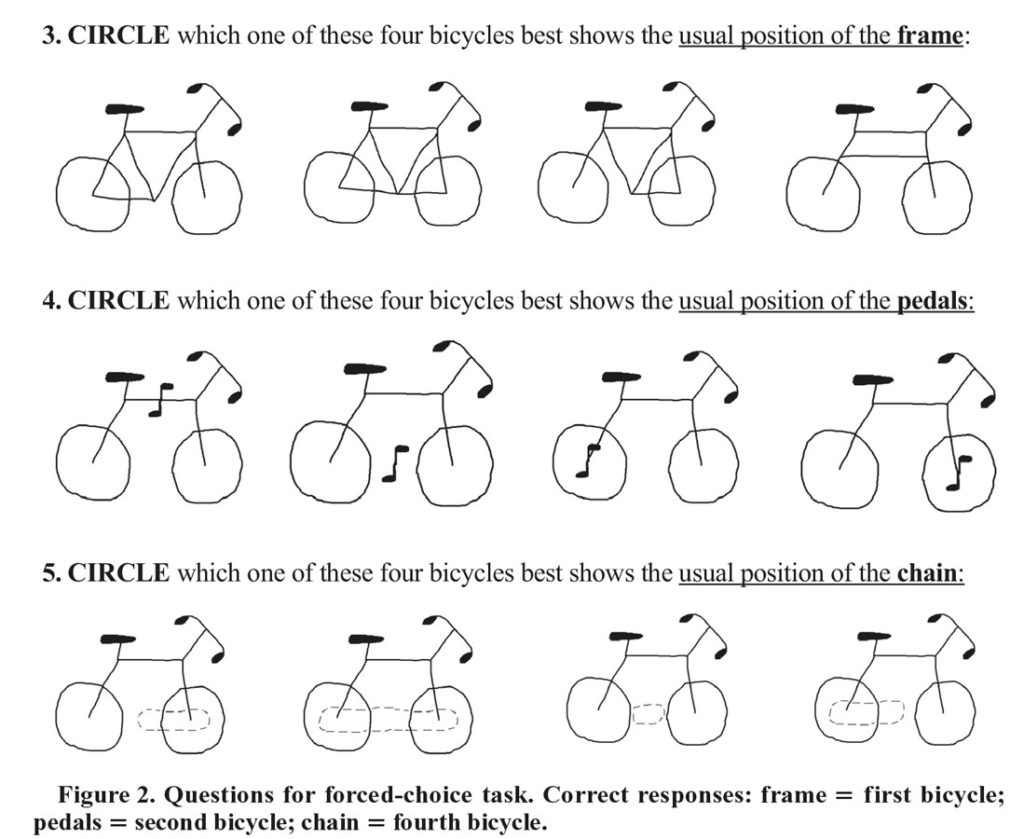

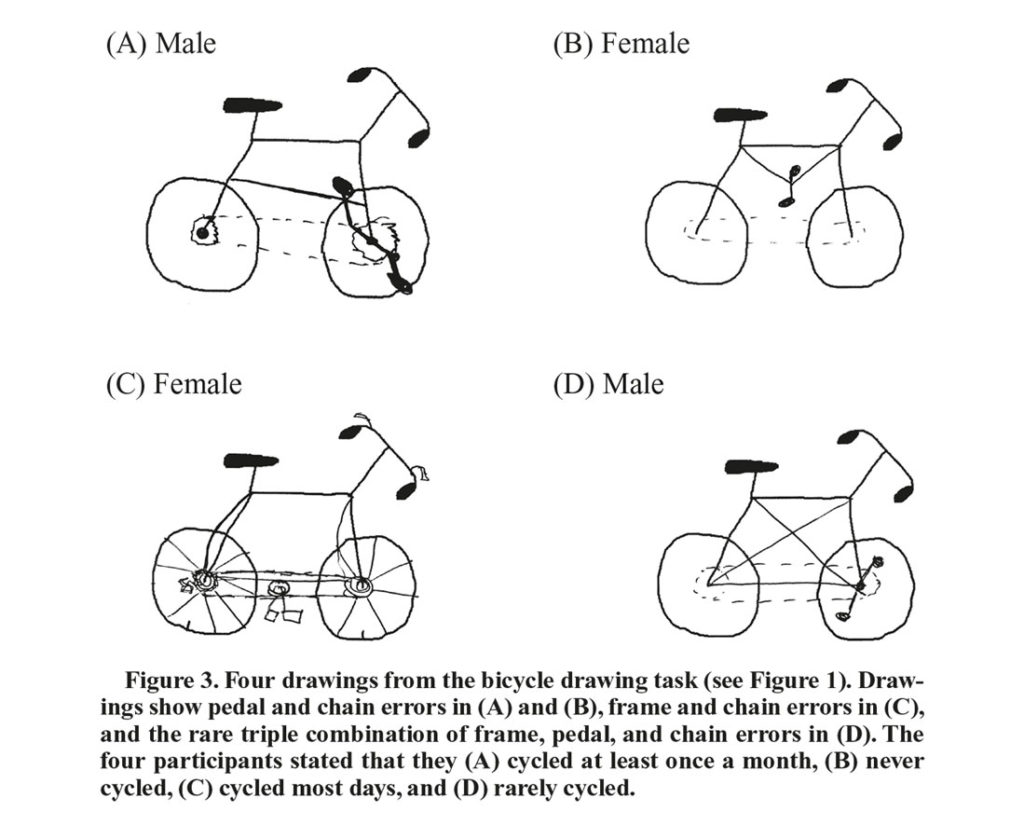

Знаете ли вы, как работают швейная машинка или спидометр? Исследования показывают, что вряд ли.

В 2002 году психологи из Йельского университета Леонид Розенблит и Фрэнк Кейл опубликовали исследование, основанное на серии экспериментов, в которых испытуемые должны были объяснить устройство простых предметов. Среди предложенных объектов были спидометр, застежка-молния, кварцевые часы, швейная машинка и другие.

Сначала участники экспериментов должны были оценить свое знание предмета от одного до семи — от «ничего не смыслю» до «отлично разбираюсь». Следующий этап — ответ на дополнительные вопросы, на которых участники обычно сыпались. Оказывалось, что о предметах они знали намного меньше, чем считали до этого. «Большинству людей кажется, что они понимают мир с гораздо большей детализацией, связностью и глубиной, чем есть на самом деле», — сказали в исследовании ученые. Это когнитивное искажение стало называться иллюзией глубины понимания (the illusion of explanatory depth).

Иллюзия глубины понимания находит отражение и в политике. В 2013 году группа американских ученых опубликовала результаты серии экспериментов, чтобы узнать, как крайние политические взгляды американцев соотносятся с пониманием политических вопросов. Они узнали мнение респондентов о разных направлениях государственной политики — от здравоохранения и социального обеспечения до политики в отношении Ирана и квот на углеродный выброс. Следом исследователи попросили описать механизм (что и зачем делается), а после — оценить уверенность в собственных взглядах и степень понимания темы. На завершающем этапе ученые просили участников экспериментов принять политические решения в пользу той или иной группы интересов.

Результаты оказались такими: люди крайних позиций излишне уверены в своей правоте, но как только им приходится разбираться в причинно-следственных связях политических решений, их взгляды становятся более умеренными. Но, как позже заметил психолог Стивен Сломан — один из соавторов исследования, — это не работает, если в основе политических взглядов — ценности, не позволяющие идти на компромиссы.

Мотивированное рассуждение

Климат меняется, и в разговорах это стало общим местом: c 1901 по 2020 год среднегодовая температура поднялась на 1,1 ℃. Но вот в чем люди расходятся, так это в причинах изменений. Политологи Джеймс Дракман и Мэри Макграт из Северо-Западного университета в Чикаго считают, что точки зрения людей на причины изменений климата связаны с их политическими предпочтениями.

«Демократы и либералы склонны считать, что человеческая деятельность является основной причиной изменения климата, — пишут исследователи, — тогда как республиканцы или консерваторы гораздо реже придерживаются этого мнения».

В основе этого явления — мотивированное рассуждение. Это когнитивное искажение, когда люди воспринимают — или игнорируют — информацию исходя из собственных представлений о мире. Мотивированное рассуждение (Motivated reasoning) стало важной теоретической концепцией не только в психологии, но и в политологии и исследованиях медиа.

«Люди с большей вероятностью придут к выводам, к которым они хотят прийти, — писала социальный психолог Зива Кунда, — но их способность сделать это ограничена их способностью конструировать кажущиеся разумными обоснования этих выводов». Иначе говоря, при желании люди могут обосновать все что угодно, если это соответствует их текущим убеждениям.

Однако Никита Логинов делает важную оговорку об исследованиях когнитивных искажений: «В американском академическом сообществе популярны исследования, которые сравнивают склонность к когнитивным искажениям у людей либеральных и консервативных взглядов. Но консенсуса, если ли связь между взглядами и склонности к когнитивным искажениям, еще нет. Есть более интересный и проверенный сюжет, касающийся мотивированных рассуждений. Это partisanship bias — про то, что рассуждения и либералов, и консерваторов примерно одинаково могут быть искажены их собственными политическими убеждениями. И при интерпретации одних и тех же фактов они приходят к разным выводам. А еще средиамериканских консерваторов больше сторонников теории заговоров. Но напрямую к когнитивным искажениям это не относится».

Фрейминг

Баннеры в метро, посты в соцсетях, проморолики перед фильмами и сериалами, а еще листовки в почтовых ящиках и в заказах с едой — из каждого угла кричит реклама. Например, американцам приходится видеть от четырех до 10 тысяч рекламных объявлений в день. Но это данные за 2015 год — вероятно, сейчас их еще больше.

При этом все объявления объединяет общая структура: их задача — привлечь внимание, чтобы потом конвертировать его в покупку. Важное значение имеет не столько содержание рекламы, сколько ее оформление. Даниэль Канеман и Амос Тверски называли это фреймингом (framing).

В 1981 году ученые показали, что если одну и ту же задачу сформулировать по-разному, то люди будут выбирать решение с подсвеченными положительными аспектами. При этом не важно, что это — денежный выигрыш или лечение от смертельной болезни. Один из гипотетических примеров в исследовании ученых выглядит так:

Представьте, что США готовятся к вспышке необычной азиатской болезни, которая, как ожидается, унесет жизни 600 человек. Были предложены две программы борьбы с болезнью. Предположим, что точная научная оценка последствий программ такова:

Если будет принята Программа А, будет спасено 200 человек.

Если будет принята Программа Б, то вероятность спасения 600 человек составит 1/3, а вероятность того, что никто не будет спасен, — 2/3.

Какую из двух программ вы бы предпочли?

На этот вопрос ответили 152 человека. 72% выбрали первый вариант, тогда как второй — 28%. «В той задаче большинство опрошенных предпочли избежать риска, — пишут ученые. — Безусловная возможность спасения 200 жизней привлекательнее, чем рискованная возможность, где есть один из трех шансов на спасение 600 жизней».

В исследования принимала участие еще одна группа респондентов (155 человек), которой предложили задачу с альтернативной формулировкой.

Если будет принята Программа С, погибнет 400 человек.

Если будет принята программа D, то вероятность того, что никто не умрет, составляет 1/3, а вероятность, что погибнет 600 человек, — 2/3.

Какую из двух программ вы бы предпочли?

Большинство (78%) в этом случае пошло на риск: опрошенные предпочли второй вариант, то есть гарантированная смерть 400 человек оказалась менее приемлемой, чем высокая (2/3) вероятность смерти всех 600 человек. Эти примеры иллюстрируют, что если выбор связан с потенциальной выгодой, то люди стараются избегать риска. Но если выбор сопряжен с потерями, то люди часто рискуют. Однако обе ситуации практически идентичны — разница лишь в том, как сформулированы условия.

Что читать о когнитивных искажениях?

- Канеман Д., Тверски А., Словик П. Принятие решений в неопределенности. — М., 2005

- Станович К. Рациональное мышление. — М., 2012

- Сломан С. Иллюзия знания. Почему мы никогда не думаем в одиночестве. — М., 2017

- Канеман Д. Думай медленно… решай быстро. — М., АСТ, 2017

- Касс Санстейн и Ричард Талер. Nudge. Архитектура выбора. — М.: Манн, Иванов и Фербер, 2017